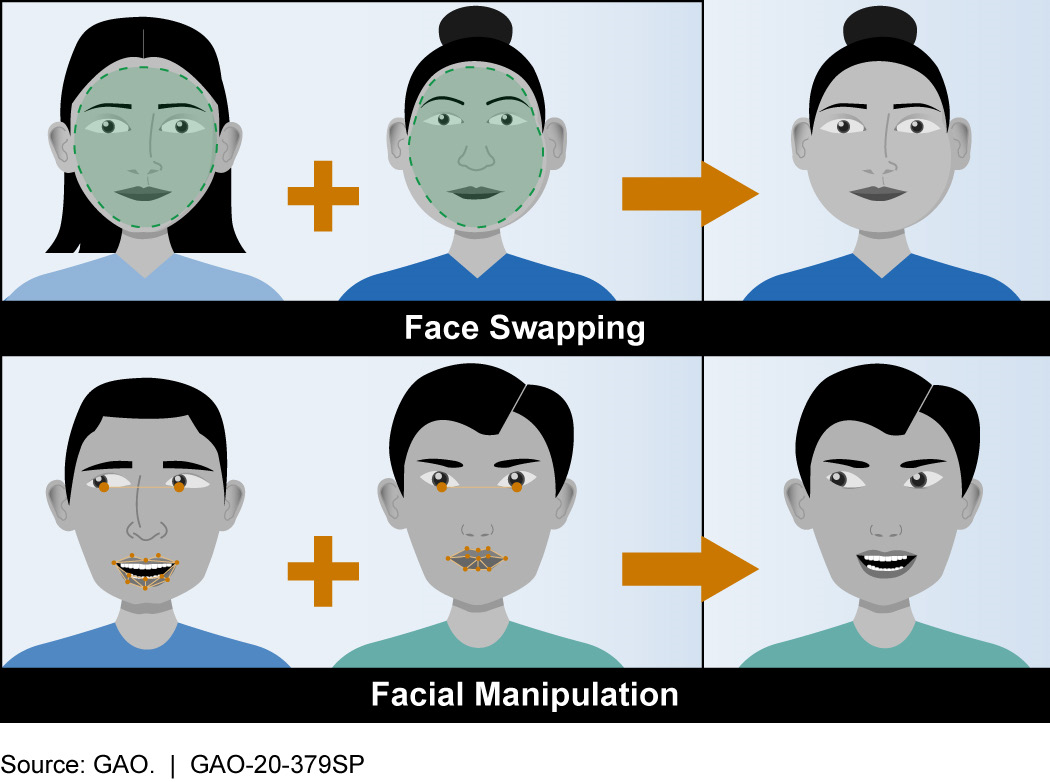

¿Qué es? Un deepfake es una grabación de video, foto o audio que parece real pero ha sido manipulada con IA. La tecnología subyacente puede reemplazar rostros, manipular expresiones faciales, sintetizar rostros y sintetizar el habla. Deepfakes puede representar a alguien que parece decir o hacer algo que, de hecho, nunca dijo o hizo.

Es parte de un problema creciente de delincuentes que utilizan inteligencia artificial (IA).

Hacerse pasar por otra persona es más fácil de lo que piensas

"Con los últimos avances en síntesis de voz, los sistemas como VALL-E pueden crear un clon de voz de alta calidad con solo una grabación registrada de 3 segundos de un hablante invisible", dijo a Lifewire Vijay Balasubramaniyan, director ejecutivo de la firma de seguridad cibernética Pindrop . en una entrevista por correo electrónico.

Cómo funcionan las estafas de clonación de voz con IA

Las estafas de clonación de voz de IA a menudo comienzan con una llamada de alguien que suena como un miembro de la familia. El estafador dice que su ser querido está en problemas y necesita dinero para una emergencia relacionada con un accidente automovilístico o una factura del hospital. De hecho, la persona que habla por teléfono es un extraño que usa un software de clonación de voz.

"La inteligencia artificial ya no es una idea descabellada de una película de ciencia ficción. Vivimos con ella, aquí y ahora", escribe la FTC en su sitio web. "Un estafador podría usar IA para clonar la voz de su ser querido. Todo lo que necesita es un breve clip de audio de la voz de su familiar, que podría obtener del contenido publicado en línea, y un programa de clonación de voz. Cuando el estafador lo llama , sonará igual que su ser querido".

La clonación de voz permite a los usuarios recrear los patrones vocales únicos de un individuo. Sin embargo, también es un arma de doble filo, dijo en un correo electrónico Tamás Kádár , el CEO de la empresa de prevención de fraude SEON . El peligro surge cuando esta tecnología cae en manos equivocadas.

“Las personas sin escrúpulos pueden usar la clonación de voz para engañar, manipular y explotar a otros, con el potencial de causar graves daños emocionales y financieros”, agregó Kádár. "Esto es especialmente preocupante a medida que el software de clonación de voz se vuelve más accesible y asequible, lo que abre una caja de pandora de posibilidades nefastas".

La emergencia familiar no es la única estafa que utiliza la clonación de voz. Kádár dijo que otro fraude común es cuando el estafador se hace pasar por un miembro de la familia o un amigo cercano, generalmente alegando que necesita asistencia financiera debido a un accidente o una situación urgente. “La víctima, pensando que está ayudando a un ser querido, envía dinero, solo para descubrir más tarde que era una estafa”, agregó.

Otra estafa es el fraude del director general, cuando un estafador clona la voz del ejecutivo de una empresa y se pone en contacto con los empleados, solicitando que transfieran fondos o divulguen información confidencial. El empleado, pensando que está siguiendo las órdenes de un superior, sin saberlo, activa la estafa.

Los abuelos son cada vez más vulnerables a las estafas de clonación de voz, dijo Steven JJ Weisman , un experto en robo de identidad, en una entrevista por correo electrónico. El estafador puede obtener una grabación de la voz de un nieto de las redes sociales y replicarla usando tecnología de IA.

Señaló el caso de Ruth Card de Canadá, a quien un estafador estafó con CAD 3000 y usó la tecnología de clonación de voz de IA para hacer una llamada que parecía provenir de su nieto . La persona que llamó dijo que su nieto estaba en la cárcel y necesitaba el dinero de inmediato para pagar la fianza.

"Todo lo que se necesita es un software de generación de voz de IA y tan solo 30 segundos del audio del nieto", dijo Weisman.

Con estas 5 aplicaciones se pueden crear “deep fakes” de fotos y videos:

1. Reface

Reface, que antes se llamaba Doublicat, permite recortar fotos y videos para dar rienda suelta a la imaginación. Una de las características más destacadas es que permite intercambiar rostros o poner la imagen del usuario en diferentes clips. Se pueden combinar caras, crear memes y añadir filtros.

Cuenta con una gran variedad de contenido y opciones. En esta app como en todas las de su tipo, el usuario debe habilitar el acceso a la cámara para que el sistema registre las facciones y logre fusionar su imagen en algunos de los contenidos ofrecidos. Es posible generar archivos de video o GIF que se pueden compartir por medio de WhatsApp, Telegram y otras tantas plataformas. Está disponible para iOS y Android.

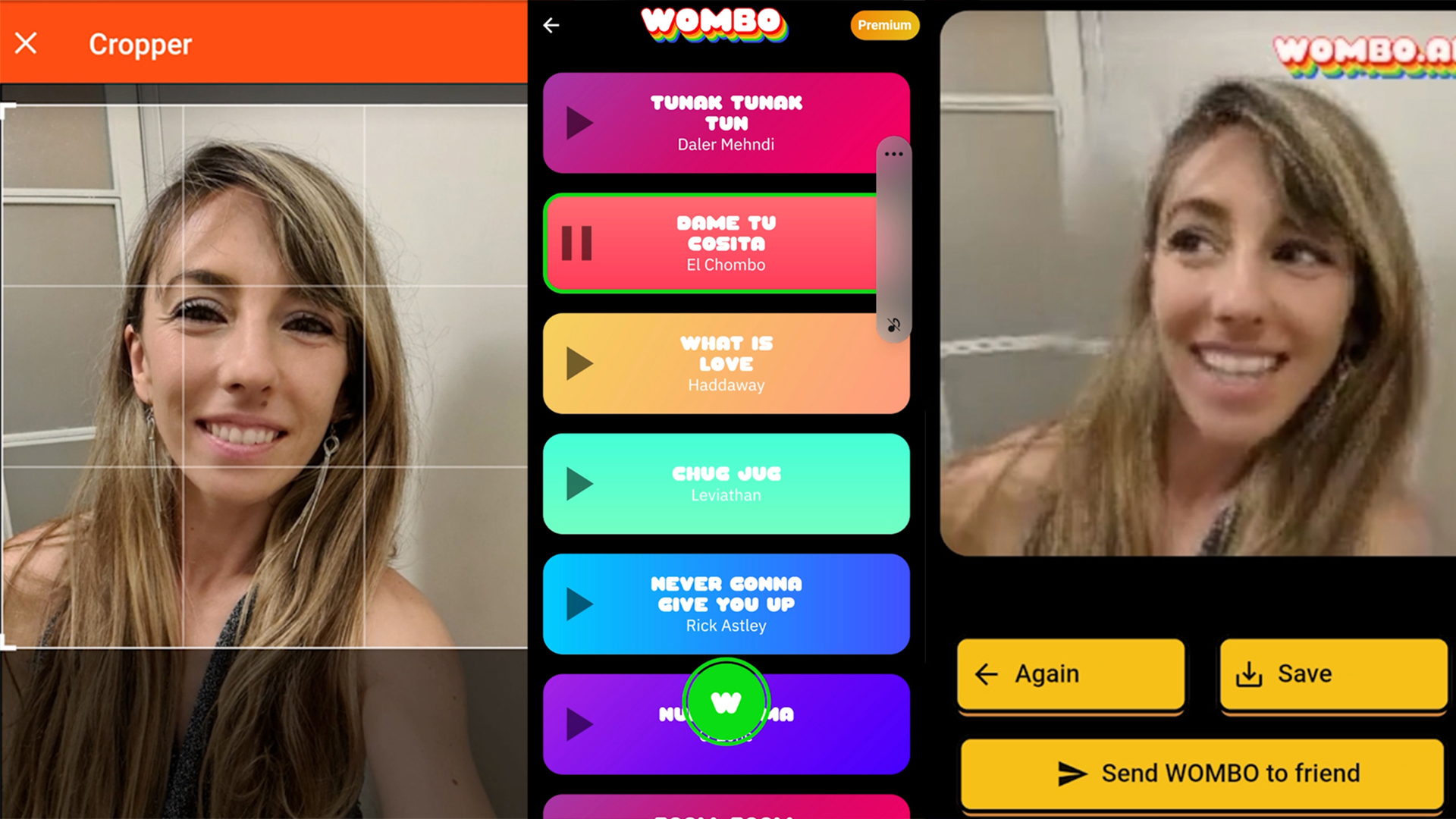

2. Wombo

Wombo es una aplicación basada en inteligencia artificial que permite darle movimientos a la selfies. Basta con cargar una imagen del rostro o bien tomar una foto en el momento, desde la app, y luego el sistema procesa el contenido para ofrecer, en pocos segundos, un pequeño video animado donde se ve al usuario cantando.

El algoritmo de AI transforma fotos estáticas en videos rápidos y expresivos. Los resultados pueden variar según la imagen que se suba. Es importante encuadrar bien el rostro o la cara retratada antes de presionar el botón para que comience el procesamiento del contenido. Se puede descargar tanto en móviles Android como iPhone.

3. Deep Nostalgia

La plataforma Deep Nostalgia dentro del sitio MyHeritage permite animar fotos. En ese caso no es posible hacer cantar a las imágenes sino simplemente hacerles mover el rostro de un costado a otro, así como hacer guiños. La herramienta está pensada para fotos antiguas, porque cuenta con un algoritmo que permite optimizar la calidad de esas imágenes.

La función Deep Nostalgia utiliza varios videos modelos para animar los rostros. Cada video modelo consiste en una secuencia fija de movimientos y gestos. El clip modelo guía los movimientos en la animación para que se pueda ver los rostros de antepasados girar la cabeza, parpadear y sonreír, tal como se explica en la página oficial. Para probar esta herramienta hay que ingresar al sitio web mencionado aquí.

4. FacePlay

Hay una variedad de plantillas de video cortas para cambiar la cara del clip en apenas un toque. El primer paso consiste en dejar que el sistema escanee el rostro y luego hay que seleccionar el video que se desea protagonizar. El resto del trabajo queda en manos de la inteligencia artificial que permite crear un video con rostro cambiado en pocos segundos. Está disponible para iOS y Android.

5. FaceJoy

Este editor de fotos y videos permite hacer intercambio de rostros para ponerse en la piel de personajes y celebridades. Es posible fondo, de forma manual y utilizar las plantillas integradas. Las fusiones están muy bien logradas, se obtienen imágenes muy realistas. El usuario puede añadir cambios o ediciones para hacer los últimos retoques. La aplicación también permite hacer cambio de género e incorporar otro tipo de filtros. Está disponible en Android.

Detectar una estafa de clonación de voz

Puede protegerse de las estafas de clonación de voz de IA al tener cuidado con las llamadas no solicitadas que solicitan información personal o financiera. De acuerdo con la FTC, los estafadores a menudo le piden que pague o envíe dinero de manera que sea difícil recuperar su dinero. Si la persona que llama dice que transfiera dinero, envíe criptomonedas o compre tarjetas de regalo y le dé los números de tarjeta y los PIN, podrían ser signos de fraude.

Balasubramaniyan dijo que es una bandera roja si estás sujeto a manipulación emocional y tácticas de alta presión. "Si un usuario se siente obligado a ayudar en estas situaciones, cuelgue y vuelva a llamar al contacto de forma independiente usando un número de teléfono conocido", agregó.

En el futuro, puede haber formas de detectar estafas de IA. "Las empresas están creando tecnología para detectar la clonación de voz", dijo Balasubramaniyan. "Estas tecnologías de detección utilizan el conocimiento de la producción y evolución de la voz humana para determinar cuándo una voz es un clon al recrear la anatomía física del habla en cuestión y determinar las anomalías en ese habla".

Anuncio: Comparación de precios y seguimiento de precios de más de 600,000 productos: consulte Comparador de precios y ofertas online

- NGLTYQ?:uenta con su apoyo. Considere contribuir con el botón a continuación para seguir brindando contenido excelente.

Ya conoces nuestro canal de YouTube? ¡Suscríbete!

Te ha resultado útil esta información? Tus comentarios nos ayudan a mejorar esta web

Si te ha gustado esta información, por favor apoya nuestro trabajo y este sitio web: compartir o comentar este artículo es un buen comienzo!. Para cualquier duda puedes dejarnos su comentario recibirás una respuesta lo mas rápido posible.

Puedes seguirnos en Twitter o unirse a nuestro Fan Page Facebook , Grupo Facebook, Instagram, Suscribirte a nuestro canal de You Tube para mantenerse actualizado sobre lo último en tecnología móvil e informática en general

:max_bytes(150000):strip_icc():format(webp)/GettyImages-1460543083-9c054d0c742b4bc29c6a800353645d0f.jpg)